OpenAI hat die ChatGPT-Limits verschärft. Was das für Plus, Pro und schwere Nutzung bedeutet

Eine genaue Analyse dazu, wie OpenAI die Limits kostenpflichtiger ChatGPT-Pläne im Jahr 2026 verändert hat: was strenger geworden ist, warum das Unternehmen auf ein neues Zugangsmodell umstellt, wie das mit Codex, Fallback-Modellen, Credits und Compute-Druck zusammenhängt und was Nutzer als Nächstes erwarten sollten.

damit sollte man anfangen

Wenn du nur die Kurzfassung brauchst, dann diese: OpenAI tut nicht länger so, als ließe sich schwere ChatGPT-Nutzung dauerhaft in einer festen Subscription verstecken. Das Unternehmen baut den Zugang offen so um, dass Limits weiter Nachfrage glätten, während alles oberhalb eines “normalen” Nutzungsprofils in eine höhere Stufe, Credits oder ein leichteres Fallback-Modell verschoben wird.

Beyond rate limits schreibt OpenAI direkt, dass die alte Strategie des einfachen Hochziehens von Limits nicht mehr funktioniert, weil die Nachfrage schneller gewachsen ist als erwartet. [5]Auf Ebene der offiziellen Kommunikation sagt OpenAI nicht “wir haben Plus generft”, sondern “wir aktualisieren Plus und Pro, um die wachsende Codex-Nutzung besser zu unterstützen”. Genau so wurde das Update im offiziellen X-Post gerahmt, den die Community dann weitergetragen hat. [10]

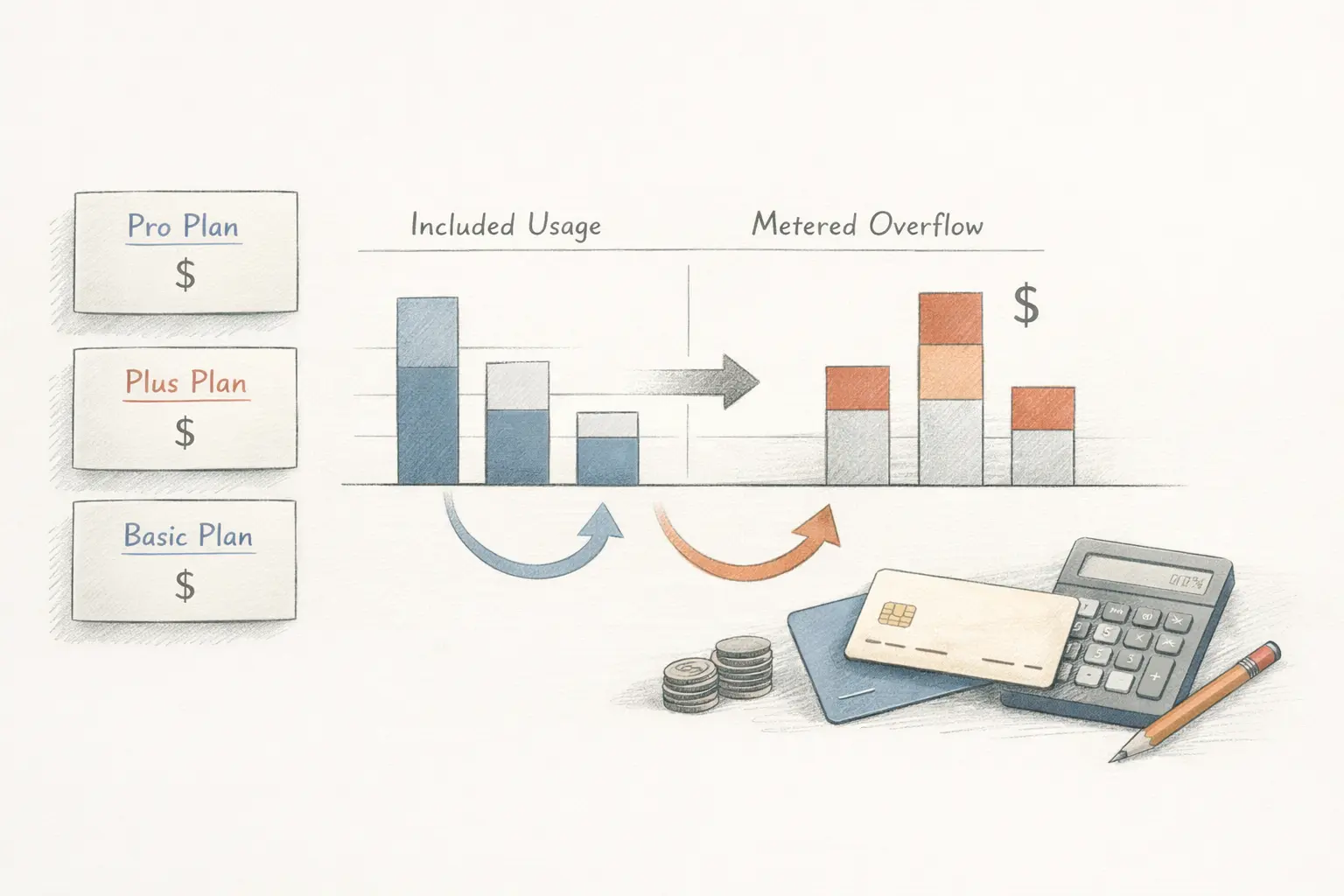

Wenn man die Änderungen sauber auseinanderzieht, ist das Bild aber ziemlich klar. Erstens hat OpenAI einen neuen $100-Pro-Plan zwischen Plus und die bisherige $200-Pro-Stufe geschoben. Zweitens entfernt es sich bei schwerer Nutzung von vagen Versprechen über “höhere Limits” und ersetzt sie durch eine deutlich klarere Hierarchie: inkludierte Nutzung, Fallback, Credits oder ein teurerer Tarif. [1][3][4]

Bei Codex wird dieser Shift besonders deutlich. Im Februar schrieb OpenAI noch von generous access für eine begrenzte Zeit und späterem Übergang zu rate-limited access und flexible pricing, also bezahlter Fortsetzung obendrauf. [7] Genau dieses Modell ist jetzt real im Produkt angekommen. [4][5]

Für Nutzer fühlt sich das genau wie ein Nerf an, auch wenn OpenAI andere Worte benutzt. Der praktische Effekt ist simpel: Was früher wie eine breitere inkludierte Reserve wirkte, schiebt dich heute schneller in Fallback, Credits oder ein Upsell, wenn deine Sessions lang und teuer sind.

Wenn man nur auf die Nutzerreaktionen schaut, ist die einfache Lesart: Das Unternehmen wollte für dasselbe Geld weniger geben. Die offiziellen Quellen zeigen aber ein vollständigeres Bild. Nachfrage, Compute-Druck, agentische Nutzung und Monetarisierung drängen inzwischen in dieselbe Richtung.

1. Die Nachfrage ist schneller gewachsen als erwartet

In Beyond rate limits: scaling access to Codex and Sora sagt OpenAI direkt, dass sowohl Codex als auch Sora im letzten Jahr sehr schnell gewachsen sind und Nutzer regelmäßig an Limits stoßen, sobald sie den echten Wert der Tools erfahren. [5]

2. Limits einfach anzuheben funktioniert nicht mehr

Im selben Text schreibt OpenAI, dass pauschal höhere Limits demand smoothing und fairness controls schwächen und das System schneller an die Kapazitätsgrenze bringen. Genau dieser Satz erklärt die Logik der schärferen Grenzen besser als jedes Marketing. [5]

3. OpenAI hat bereits gezeigt, dass Serving-Kapazität ein reales Limit ist

Im Write-up vom 10. Februar beschreibt OpenAI erhöhte Fehlerraten bei bezahlten GPT-5.2-Plänen ausdrücklich als temporary serving capacity shortfall. Das beweist nicht, dass jede neue Grenze aus genau diesem Vorfall stammt, ist aber ein starkes offizielles Signal dafür, dass Serving-Kapazität operativ begrenzt ist. [9]

4. Das Unternehmen bewegt sich auf ein hybrides Zugangsmodell zu

Über Help-Center-Texte und Produktposts hinweg ist die neue Verkaufslogik klar: Ein Tarif gibt dir den Baseline-Zugang, Rate Limits formen die Peak-Nutzung, und Credits lassen dich weiterarbeiten, statt hart zu stoppen. Das ist keine reine Subscription und auch kein reines Pay-as-you-go. Es ist ein Hybrid. [4][5]

Auf dem Papier kann OpenAI das als besseres Zugangsmodell beschreiben. In der täglichen Arbeit fühlt es sich deutlich konkreter an.

| Comparison point | Was die offizielle Quelle sagt | Was das in der Praxis bedeutet |

|---|---|---|

| GPT-5.4 Thinking | Plus- und Business-Nutzer erhalten bis zu 3.000 Nachrichten pro Woche, danach ist das Modell manuell nicht mehr verfügbar. [2] | Schwere Reasoning-Sessions wirken damit deutlich stärker wie eine quotierte Ressource und nicht wie ein Premium-Modus, den man unbegrenzt durchdrücken kann. |

| Fallback nach dem Limit | Nach Erreichen der GPT-5.4-Thinking-Grenze fallen bezahlte Nutzer auf GPT-5.4 mini zurück. [1] | Die Arbeit stoppt nicht komplett, aber Qualität und das Gefühl von “inkludiertem Flaggschiff-Zugang” sind in langen Sessions nicht mehr garantiert. |

| Codex-Nutzung | Nach Verbrauch der inkludierten Nutzung können Nutzer Credits kaufen, statt sofort zu einem höheren Tarif gezwungen zu werden. [4] | Die Subscription sieht immer mehr wie ein Basispaket mit bezahlter Erweiterung obendrauf aus, nicht wie ein abgeschlossener Flat-Preis. |

| Pro-Stufen | Pro $100 gibt 5x Nutzung gegenüber Plus und vorübergehend 10x für Codex. Pro $200 bleibt die höchste Usage-Stufe. [1][3] | Nutzer werden gezielter segmentiert: Plus für leichtere Nutzung, Pro für echte tägliche Arbeit und die oberste Stufe für teure, parallele, lang laufende Workflows. |

Das ist der Schlüsselpunkt im gesamten Bild. Würde OpenAI nur normale Chat-Limits verändern, sähe es wie eine weitere milde Preiskorrektur aus. Tatsächlich dreht sich fast alles hier um Codex, also um agentische, tool-lastige und deutlich teurere Nutzungsmuster. [1][5][7]

Im Help-Artikel über Codex mit ChatGPT-Plan erklärt OpenAI ausdrücklich, dass die Nutzung nicht nur von der Zahl der Nachrichten abhängt, sondern von Codebase-Größe, Aufgabenkomplexität, Sitzungsdauer und davon, ob die Aufgabe lokal oder in der Cloud läuft. [8] Genau deshalb passt diese Art von Workload schlecht in die alte Logik “ein Plan, eine ungefähre Großzügigkeit”.

An diesem Punkt hört das neue Modell auf, sich zu verstecken. Nutzer verbrauchen erst ihr inkludiertes Volumen und können dann Credits direkt in Codex dazukaufen. [4] Das wirkt wie OpenAIs Versuch, sowohl die Service-Performance zu schützen als auch schwere Engineering-Nutzung näher an ein API-artiges ökonomisches Modell zu bringen, ohne Nutzer aus der ChatGPT-Subscription herauszudrängen.

Wichtig ist, Fakten und Stimmung auseinanderzuhalten. Die offiziellen Quellen sagen dir, was OpenAI geändert hat. Community-Diskussionen zeigen, wie sich diese Änderungen in der echten Nutzung anfühlen.

Wenn man alle offiziellen Texte zusammennimmt, wirkt das nicht wie eine vorübergehende Anomalie. Es sieht nach einer klaren Produktlinie aus.

Kurz gesagt

Am wahrscheinlichsten ist nicht die Rückkehr zur alten Großzügigkeit. Realistischer sind feinere Tarifsegmente, mehr Fallback-Verhalten und ein engeres Zusammenwachsen von Subscription-Zugang und metered overflow.

OpenAI hat nicht einfach ein paar Zahlen in einer Preistabelle geschrumpft. Das Unternehmen schreibt gerade die Zugangsphilosophie für teure AI-Szenarien in ChatGPT neu. Für leichte Nutzung funktioniert die Subscription noch wie ein vertrautes Produkt. Für schwere Nutzung wird sie immer stärker zu einem Basispaket vor Fallback, Credits oder Plan-Upgrade.

Für Plus-Nutzer ist die wichtigste Erkenntnis einfach: Wenn du ChatGPT als ernsthaftes tägliches Arbeitstool verwendest, vor allem über Codex oder reasoning-lastige Modelle, verschwindet das alte Gefühl “es reicht für fast alles”. Für Pro-Nutzer ist die Schlussfolgerung etwas anders: OpenAI versucht klar, diese Stufe sinnvoller zu machen als nur teureres Plus.

Für den Markt insgesamt ist das Signal noch breiter. Generative Produkte, die einmal wie fast grenzenlose Subscriptions wirkten, bewegen sich in hybride Zugangsmodelle. Wenn dieser Trend anhält, werden Nutzer weniger abstrakte Großzügigkeit und mehr explizite Grenzen, Fallback-Logik und Pay-as-you-go-Overflow obendrauf sehen.

Offiziell spricht OpenAI über aktualisierte Plus- und Pro-Pläne, Fallback-Modelle, Credits und eine neue Tarifstruktur. Aus Nutzersicht fühlt sich das aber klar wie strengere Grenzen für schwere Szenarien an, besonders rund um Codex und reasoning-lastige Nutzung.

Weil das Unternehmen selbst sagt, dass pauschal höhere Limits demand smoothing und fairness controls schwächen und den Dienst schneller an Kapazitätsgrenzen führen. Für OpenAI geht es hier also nicht nur um Monetarisierung, sondern auch um operative Stabilität. [5][9]

Praktisch gibt es drei Optionen: leichtere Fallback-Modelle akzeptieren, Credits für Codex oder Sora kaufen oder auf eine höhere Stufe wechseln. Genau so ist die offizielle Produktlogik inzwischen aufgebaut. [3][4][8]

Nach allem, was in den offiziellen Texten steht, wirkt das eher unwahrscheinlich. Realistischer sind feinere Tarifsegmente, mehr Fallback-Verhalten und ein engeres Zusammenwachsen von ChatGPT-Subscription und einem Hybrid aus Subscription plus Credits.

Verwandte Artikel

AI SEO / GEO im Jahr 2026: Ihre nächsten Kunden sind nicht Menschen — sondern Agents

Suche verschiebt sich von Klicks zu Antworten. Bots und AI-Agents crawlen, zitieren, empfehlen — und kaufen zunehmend. Erfahren Sie, was AI SEO / GEO bedeutet, warum klassisches SEO nicht mehr reicht und wie PAS7 Studio Marken im agentischen Web sichtbar macht.

Der leistungsstärkste Chip von Apple? M5 Pro und M5 Max brechen Rekorde

Eine Analyse zu Apple M5 Pro und M5 Max im März 2026. Wir zeigen, warum diese Chips als die stärksten professionellen Laptop-SoCs von Apple gelten können, wie sie sich gegen M4 Pro, M4 Max, M1 Pro, M1 Max schlagen und was der Vergleich mit aktuellen Intel- und AMD-Chips zeigt.

Artemis II und der Code, der Menschen zum Mond trägt

Dieser Beitrag erklärt die NASA-Mission Artemis II, die am 1. April 2026 gestartet ist, und zeigt, was sie wirklich über moderne Technik erzählt: Flugsoftware, Backup-Logik, Simulationen, Telemetrie, menschliche Kontrolle und die vorsichtige Rolle von KI in Raumfahrtsystemen.

Automatisches Tagging und Suche für gespeicherte Links

Integration mit GDrive/S3/Notion für automatisches Tagging und schnelle Suche über Such-APIs

Professionelle Entwicklung für Ihr Geschäft

Wir erstellen moderne Web-Lösungen und Bots für Unternehmen. Erfahren Sie, wie wir Ihnen helfen können, Ihre Ziele zu erreichen.