Subagents in Codex: so funktioniert es wirklich

Praktischer Überblick über OpenAI Codex Subagents im Jahr 2026: was OpenAI genau veröffentlicht hat, wie man sie einsetzt, wo sie echten Mehrwert bringen, wo sie nur Rauschen erzeugen und wie sie Limits, Credits und Geschwindigkeit beeinflussen.

zuerst lesen

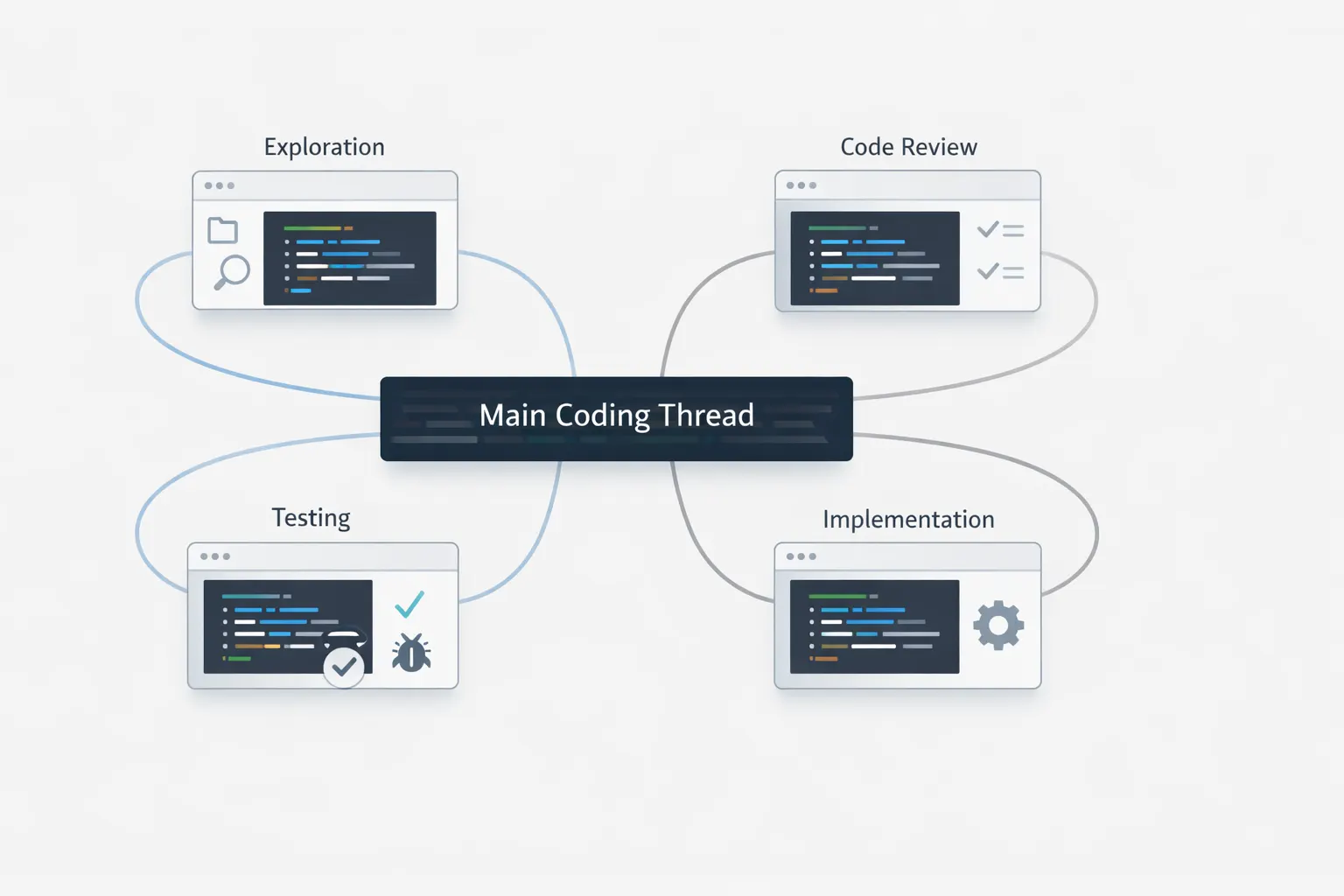

Der Punkt ist nicht, dass Codex mehr Threads öffnen kann. Der eigentliche Punkt ist, dass OpenAI einen klaren Weg formalisiert hat, den Haupt-Thread sauber zu halten, während parallele Arbeit an anderer Stelle passiert. Das beeinflusst Zuverlässigkeit, Geschwindigkeit und Kosten gleichzeitig.

OpenAI formuliert es im Produkttext ziemlich direkt. In der Ankündigung der Codex App schreibt das Unternehmen, dass die App dafür gebaut ist, manage multiple agents at once, run work in parallel und mit langen Aufgaben zu arbeiten. [4] Das ist nicht bloß ein neuer Schalter in der Oberfläche. Es ist eine Änderung daran, wie Codex größere Engineering-Arbeit aufteilen soll.

Die technische Dokumentation erklärt den praktischen Grund noch klarer. Selbst mit großen Kontextfenstern verschlechtert sich die Hauptkonversation, wenn man sie mit Logs, Traces, Zwischenhypothesen und Test-Rauschen füllt. OpenAI nennt zwei konkrete Probleme: context pollution und context rot. [1]

Das passt auch zu externer Forschung. Chroma zeigt im Bericht Context Rot, dass die Zuverlässigkeit sinkt, wenn der Kontext wächst, besonders bei schwierigeren Aufgaben. [8] Im Kern sind Codex Subagents OpenAIs Produktantwort auf genau diese technische Realität.

Anthropic beschreibt im Agent SDK einen sehr ähnlichen Ansatz aus einer anderen Perspektive: Subagents helfen bei parallelization und beim Kontextmanagement, weil sie in their own isolated context windows arbeiten. [11] Das ist nützliche Bestätigung. Es ist kein reines OpenAI-Muster, sondern entwickelt sich zu einem allgemeinen Workflow für längere Agent-Arbeit.

Wenn man das Branding weglässt, ist das Modell einfach: Ein Haupt-Thread orchestriert, ein oder mehrere Kind-Threads erledigen klar begrenzte Arbeit, und dann zieht der Parent alles wieder in ein finales Ergebnis zusammen.

Den Haupt-Thread für Anforderungen und finales Urteil reservieren

Der Parent-Thread sollte Briefing, Grenzen, Architekturentscheidungen und die finale Synthese tragen. OpenAI positioniert Subagents ausdrücklich als Weg, den Haupt-Thread auf Anforderungen, Entscheidungen und Endergebnisse zu fokussieren. [1]

Codex explizit bitten, die Arbeit auf Kind-Threads aufzuteilen

Jedem Kind eine enge Aufgabe geben

Die Dokumentation zeigt als Beispiel ein Pull-Request-Review, bei dem Codex einen Agenten pro Review-Dimension startet, etwa Security, Bugs, Race Conditions, flaky tests und Maintainability. Genau so sollte der Split aussehen: eine enge Aufgabe pro Kind-Thread. [2]

Bei Bedarf in Kind-Threads wechseln, um sie zu prüfen oder zu steuern

Im CLI kann man mit /agent in einen aktiven Agent-Thread springen, ansehen, was dort passiert, und direkt weiterarbeiten. Das ist wichtig, weil Delegation nicht blindes Vertrauen bedeutet. Kritische Entscheidungen brauchen weiterhin Review. [6]

Den Haupt-Thread das Ergebnis konsolidieren lassen

OpenAI beschreibt, dass Codex nach Abschluss der angeforderten Arbeit eine konsolidierte Antwort zurückgibt: parallele Arbeit unten, eine saubere Zusammenfassung oben. [2]

Kurz gesagt

Der Haupt-Thread sollte wie ein Lead Engineer denken. Subagents sollten wie klar abgegrenzte Spezialisten arbeiten, nicht wie frei laufende Kopien des Leads.

Dieser Teil ist wichtig, weil Subagents inzwischen nicht mehr wie versteckte interne Magie aussehen. OpenAI hat jetzt sowohl die eingebauten Rollen als auch die Konfigurationsoberfläche darum dokumentiert.

Eingebaute Rollen sind schon da

OpenAI dokumentiert drei built-in Agents: default für allgemeine Arbeit, worker für execution-heavy Implementierung und Fixes und explorer für read-heavy Codebase-Recherche. [2]

Eigene Agents lassen sich hinzufügen

Custom Agents liegen in ~/.codex/agents/ für persönliche Nutzung oder in .codex/agents/ auf Projektebene. Jeder definiert name, description und developer_instructions und kann zusätzlich Modell, Reasoning-Effort, Sandbox-Modus, MCP-Server und Skills überschreiben. [2]

Parallelität ist konfigurierbar

OpenAI dokumentiert [agents]-Einstellungen wie max_threads, max_depth und job_max_runtime_seconds. max_threads steht standardmäßig auf 6 und max_depth auf 1, damit tiefe Rekursion nicht automatisch ausufert. [2]

Subagents erben Sicherheitsregeln

Subagents übernehmen die aktuelle Sandbox-Policy. Approval-Prompts können aus inaktiven Threads kommen, und tiefere Rekursion wird nicht empfohlen, weil sie Tokenverbrauch, Latenz und lokale Ressourcenlast schnell erhöht. [2]

Viele Teams erwarten hier das Falsche. In bezahlten ChatGPT-Plänen ist das praktische Problem meist nicht rohe API-Tokenmathematik, sondern wie schnell Subagents enthaltene Limits oder Credits verbrennen.

| Comparison point | Was OpenAI sagt | Was das praktisch bedeutet |

|---|---|---|

| Subagent-Workflows | Verbrauchen mehr Tokens als ein vergleichbarer Single-Agent-Lauf. [1][2] | Parallele Delegation ist nützlich, aber keine kostenlose Beschleunigung. Jeder Kind-Thread fährt seinen eigenen Modell- und Tool-Loop. |

| GPT-5.4-mini | Verwendet rund 30% der enthaltenen Limits von GPT-5.4 und hält ungefähr 3,3-mal länger durch, bevor Limits erreicht werden. [3] | Eine starke Standardwahl für leichtere Subagents: Exploration, große Datei-Reviews, Begleitdokumente und sekundäre Analyse. |

| Lokale Kosten von GPT-5.4 | Im Schnitt etwa 7 Credits pro lokaler Aufgabe. [7] | Ein starkes Haupt-Thread-Modell, aber teuer, wenn man es gedankenlos über mehrere Kind-Threads verteilt. |

| Lokale Kosten von GPT-5.4-mini | Im Schnitt etwa 2 Credits pro lokaler Aufgabe. [7] | Deutlich sinnvoller, wenn der Subagent Unterstützungsarbeit leistet und nicht das finale Urteil tragen soll. |

| Lokale und Cloud-Kosten von GPT-5.3-Codex | Im Schnitt etwa 5 Credits pro lokaler Aufgabe und etwa 25 pro Cloud-Aufgabe. [7] | Weiterhin eine starke Option für wirklich schwere Software-Engineering-Arbeit, vor allem wenn ein coding-first Profil wichtiger ist als die breitere GPT-5.4-Ausrichtung. |

| Fast mode bei GPT-5.4 | Ungefähr 1,5x Geschwindigkeit und 2x Credit-Rate. [5] | Hilfreich bei latenzkritischer Arbeit, beschleunigt aber den Credit-Verbrauch zusätzlich zum ohnehin teureren Subagent-Fan-out. |

Subagents sind kein universelles Upgrade. Sie sind ein Koordinationswerkzeug.

Starker Fit

Lohnt sich zu testen

Größere Features, bei denen ein Kind-Thread UI übernimmt, ein anderer Backend-Änderungen und ein dritter Tests oder Migration Notes vorbereitet. Das funktioniert nur, wenn die Grenzen echt sind und das finale Urteil im Parent-Thread bleibt.

Oft Overkill

Kleine Änderungen, Bugs in einer einzelnen Datei, schnelle Refactors oder jede Aufgabe, deren eigentliches Problem nicht Größe, sondern Klarheit ist. In solchen Fällen kostet Delegation oft mehr, als sie zurückgibt.

Zone mit erhöhtem Risiko

Parallele write-heavy Arbeit in derselben Codefläche. OpenAI warnt ausdrücklich davor, dass gleichzeitige Edits Konflikte schaffen und den Koordinationsaufwand erhöhen können. [1]

Der häufigste Fehler ist banal: Nutzer bitten zu ungenau um Hilfe durch Subagents. Das funktionierende Muster ist immer gleich: den Split beschreiben, jedem Kind-Thread klare Grenzen geben und sagen, welches Ergebnis in den Haupt-Thread zurückkommen soll.

Für ein PR-Review kann ein guter Prompt so aussehen:

Spawn three subagents.

Agent 1: review security issues and secret handling.

Agent 2: review race conditions and concurrency risks.

Agent 3: review test gaps and flaky cases.

Return one merged summary with the most important findings first.Bei Implementierungsarbeit ist es wichtig, Ownership zu trennen:

Use two subagents.

Agent 1 owns the API handler and schema changes.

Agent 2 owns the frontend form and validation wiring.

Do not edit the same files. Summarize conflicts before making final edits.Bei research-heavy Aufgaben ist es sinnvoll, sofort um eine günstigere Kind-Laufzeit zu bitten:

Spawn one explorer subagent per document.

Extract only the constraints, breaking changes, and migration risks.

Use `gpt-5.4-mini` for all child threads, then summarize in the main thread.Unten stehen praktische Empfehlungen für den Einsatz von Subagents in Codex. Der Ablauf ist im Grunde ziemlich einfach.

Subagents explizit anfordern und den Split benennen

Nicht einfach investigate this schreiben. Besser ist etwas wie spawn one agent for security, one for race conditions, one for test flakiness, then summarize. Genau diese Struktur zeigt auch die Codex-Dokumentation. [2]

Den Haupt-Thread kurz und sauber halten

Der Parent-Thread sollte Scope, Einschränkungen, Acceptance Criteria und finale Entscheidungen halten. Lautes Research gehört in Kind-Threads. [1]

Kind-Threads prüfen statt nur der Summary zu vertrauen

Mit /agent im CLI lässt sich in problematische oder kritische Kind-Threads wechseln. Gerade wenn dort wichtige Entscheidungen stecken, sollte man die Details prüfen. [6]

Rekursion nicht tief aufdrehen

OpenAI setzt max_depth standardmäßig auf 1, und das nicht ohne Grund. Tiefer rekursiver Fan-out erhöht Tokenverbrauch, Latenz und lokale Ressourcenlast sehr schnell. [2]

Read-heavy und write-heavy Delegation trennen

Am besten parallelisiert man zuerst Analyse. Parallele Edits sollte man erst dann zulassen, wenn Ownership klar genug ist und Konflikte unwahrscheinlich bleiben. [1]

Die ersten Fehler sind ziemlich vorhersehbar. Fast alle entstehen dann, wenn Subagents als kostenlose zusätzliche Arbeitskraft verstanden werden und nicht als Orchestrierungswerkzeug.

Subagents für eine vage Aufgabe zu starten. Wenn die Aufgabe keine klaren Grenzen hat, vervielfacht man nur Verwirrung.

Edits in denselben Dateien parallel laufen zu lassen. Die Dokumentation warnt direkt vor Konflikten und Koordinationsaufwand in write-heavy Szenarien. [1]

Approval- und Sandbox-Vererbung zu ignorieren. Kind-Threads übernehmen die aktuelle Sandbox-Policy, und Approval-Prompts können aus inaktiven Threads auftauchen. [2]

Kurz gesagt

Subagents funktionieren am besten dann, wenn sie Rauschen entfernen und nicht bloß Aktivität um der Aktivität willen vermehren.

Nein. OpenAI sagt in der Dokumentation ausdrücklich, dass Codex Subagents nur dann startet, wenn man klar nach Subagents oder paralleler Agent-Arbeit fragt. [1][2]

OpenAI dokumentiert aktuell drei eingebaute Agents: `default`, `worker` und `explorer`. `worker` ist auf execution-heavy Arbeit ausgelegt, `explorer` auf read-heavy Codebase-Recherche. [2]

In der Regel ja. OpenAI sagt, dass Workflows mit Subagents mehr Tokens als ähnliche Single-Thread-Szenarien verbrauchen, weil jeder Kind-Thread seinen eigenen Modell- und Tool-Loop fährt. In ChatGPT-Plänen zeigt sich das praktisch als schnellerer Verbrauch von enthaltenen Limits oder Credits. [1][2][7]

OpenAIs aktuelle Logik ist: `gpt-5.4` für die Hauptaufgabe und `gpt-5.4-mini` für leichtere Coding Tasks oder Subagents. `gpt-5.3-codex` bleibt gleichzeitig eine starke Option für schwere Software-Engineering-Arbeit. [3][5]

Am meisten helfen sie bei parallelisierbarer, read-heavy Arbeit wie Exploration, Tests, Triage, Zusammenfassungen und Reviews. OpenAI empfiehlt ausdrücklich, genau dort zu beginnen und parallele write-heavy Arbeit viel vorsichtiger zu behandeln. [1]

Nicht exakt. Praktisch steigt der Verbrauch fast immer, aber OpenAI veröffentlicht keinen festen universellen Multiplikator für jeden Plan und jedes Szenario. Der tatsächliche Effekt hängt von Modell, Aufgabengröße, Kontextmenge, local oder cloud execution und der Anzahl der gestarteten Kind-Threads ab. [1][2][7]

Dieser Artikel basiert auf aktueller OpenAI-Dokumentation und Produktseiten zu Codex, Pricing, Changelog und Speed sowie auf externer Forschung zur Kontextdegradation und Materialien von Anthropic zum Agent SDK.

Verwandte Artikel

AI SEO / GEO im Jahr 2026: Ihre nächsten Kunden sind nicht Menschen — sondern Agents

Suche verschiebt sich von Klicks zu Antworten. Bots und AI-Agents crawlen, zitieren, empfehlen — und kaufen zunehmend. Erfahren Sie, was AI SEO / GEO bedeutet, warum klassisches SEO nicht mehr reicht und wie PAS7 Studio Marken im agentischen Web sichtbar macht.

Der leistungsstärkste Chip von Apple? M5 Pro und M5 Max brechen Rekorde

Eine Analyse zu Apple M5 Pro und M5 Max im März 2026. Wir zeigen, warum diese Chips als die stärksten professionellen Laptop-SoCs von Apple gelten können, wie sie sich gegen M4 Pro, M4 Max, M1 Pro, M1 Max schlagen und was der Vergleich mit aktuellen Intel- und AMD-Chips zeigt.

Automatisches Tagging und Suche für gespeicherte Links

Integration mit GDrive/S3/Notion für automatisches Tagging und schnelle Suche über Such-APIs

Bot-Entwicklung und Automatisierungs-Dienste

Professionelle Telegram-Bot-Entwicklung und Automatisierung von Geschäftsprozessen: Chatbots, KI-Assistenten, CRM-Integrationen und Prozessautomatisierung.

Professionelle Entwicklung für Ihr Geschäft

Wir erstellen moderne Web-Lösungen und Bots für Unternehmen. Erfahren Sie, wie wir Ihnen helfen können, Ihre Ziele zu erreichen.