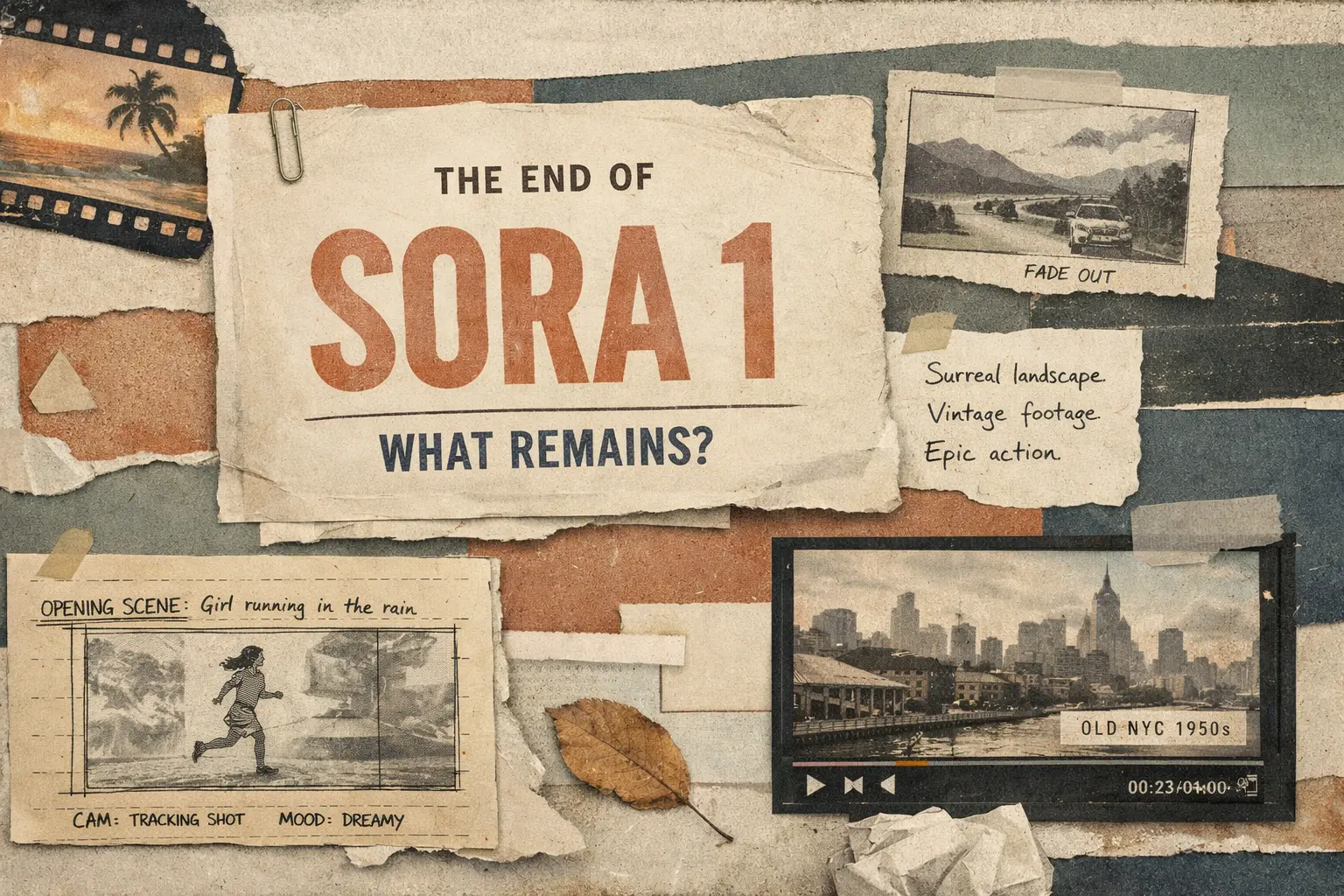

Sora 1 endet. Was bleibt von ihr?

Ein klarer Blick auf das Ende von Sora 1 im Jahr 2026: was OpenAI tatsächlich abgeschaltet hat, wie sich Sora vom Research-Preview 2024 zu Sora 2 entwickelt hat, was sie erreicht hat, warum die Legacy-Version eingestellt wurde und warum die Kritik nie ganz verstummte.

zuerst lesen

Wenn du aus diesem Text nur einen Gedanken mitnimmst, dann diesen: Das Ende von Sora 1 ist nicht dasselbe wie das Ende von Sora. OpenAI hat die alte Oberfläche abgeschaltet, weil das Unternehmen ein neueres System, einen neueren Stack und eine klarere Produktgeschichte wollte.

Das Erste, was man korrigieren sollte, ist die Überschrift selbst. Wenn wir uns an die offizielle Formulierung halten, hat OpenAI Sora als Ganzes nicht abgeschaltet. Abgeschaltet wurde Sora 1 in den USA am 13. März 2026, und die Standard-Erfahrung wurde auf Sora 2 umgestellt. [1]

Das FAQ im Help Center ist hier ungewöhnlich direkt. Dort steht: Sora 1 ist in den USA nicht mehr verfügbar, Sora öffnet sich standardmäßig in Sora 2, und Bildgenerierung innerhalb von Sora ist nach dem Entfernen von Sora 1 nicht mehr verfügbar. [1] Gerade dieser letzte Punkt zeigt, wie stark das ursprüngliche Web-Produkt am älteren Stack hing.

Auch OpenAIs Begründung ist klar: Sora 1 basierte auf older models and infrastructure, und der Wechsel auf eine einzige Erfahrung reduziert Komplexität, während Sora 2 auf Web und Mobile weiter verbessert werden kann. [1] Das klingt weniger nach dramatischer Beerdigung und mehr nach einer Produktkonsolidierung nach einer sehr schnellen Experimentierphase.

Sora hat sich ungewöhnlich schnell bewegt. In etwas mehr als zwei Jahren ging es vom Research-Preview, der die gesamte Branche aufschrecken ließ, zu einer Consumer-App und dann zu einer Legacy-Schicht, die OpenAI bereit war abzuschalten.

Sora erscheint als Research-Schock

OpenAIs Research Paper stellte Sora als Modell vor, das bis zu eine Minute hochqualitatives Video erzeugen kann. Noch wichtiger war aber, dass es object permanence, längere Kohärenz, Kamerabewegung, Looping, Video Extension, Video Interpolation und einen plausiblen Pfad zu world-simulation-artigen Modellen zeigte. [3]

Sora wird zu einer echten Produktoberfläche

Als Sora breiter verfügbar wurde, stellte OpenAI sie bereits als mehr als nur ein Model-Demo dar. AP erwähnte den öffentlichen Release, aber auch die frühen Einschränkungen bei der Darstellung von Menschen. Das zeigte, dass dem Unternehmen bewusst war, dass das Risikoprofil hier anders ist als bei gewöhnlichen Bildtools. [6]

Sora 2 verschiebt den Schwerpunkt

OpenAI beschrieb Sora 2 als physikalisch präziser, realistischer, besser kontrollierbar und fähig, synchronen Dialog und Soundeffekte zu erzeugen. Außerdem startete sie über eine neue Sora-App und nicht nur als Web-Experiment. [4]

Die App bekommt echte Produktfunktionen

Die Release Notes zeigen, wie schnell das Produkt reifte: Storyboards, Cameos und später Characters, Stitching, Styles, Android-Support, längere Dauer, image-to-video mit Menschen unter strengeren Guardrails und Video Extensions. [5]

Sora 1 wird zum Legacy-Zweig

OpenAI stellt Sora 1 in den USA ein, verschiebt Nutzer standardmäßig zu Sora 2 und entfernt die Bildgenerierung aus Sora selbst. Genau in diesem Moment hört die Sora der ursprünglichen Web-Ära auf, die Hauptgeschichte des Produkts zu sein. [1]

Kurz gesagt

Sora hatte nicht nur ein Leben. Erst ein Research-Leben, dann ein App-Leben. Heute bleibt nur das zweite.

Oft wird Sora auf 'die AI-Video-App, die gut aussah' reduziert. Das greift zu kurz. Wichtig war, dass Sora mehrere Entwicklungsschritte der gesamten Branche in sehr kurzer Zeit zusammengezogen hat.

Sie machte langes AI-Video plausibel

Das Research Paper von 2024 zeigte nicht nur schöne Clips. Es argumentierte, dass großes Video-Training minutenlange Sequenzen, verschiedene Seitenverhältnisse, Looping, Extension und kohärentere Multi-Shot-Ausgaben ermöglichen kann, als der Markt damals gewohnt war. [3]

Sie brachte die Debatte über world models in den Mainstream

Sie machte Videogenerierung zu einem Produkt statt nur zu einer Demo

Sie bewegte sich schneller als das öffentliche Vertrauen

Am einfachsten versteht man den Sunset, wenn man die Produktlogik von Sora 1 und Sora 2 direkt vergleicht. Sie teilen sich den Namen, aber nicht dieselbe Produktstrategie.

| Comparison point | Sora 1 / ursprüngliche Web-Ära | Sora 2 / aktuelle Richtung |

|---|---|---|

| Kernidentität | Legacy-Web-Erfahrung, gebunden an ältere Video- und Bildgenerierung. [1] | Einzige Standard-Erfahrung von Sora, zentriert auf neuere Modelle und ein breiteres App-plus-Web-Produkt. [1][4] |

| Zentrale Produktbehauptung | Der Beweis, dass hochqualitatives, längeres AI-Video überhaupt funktionieren kann. [3] | Ein physikalisch präziseres, besser kontrollierbares Modell mit synchronem Dialog und Soundeffekten. [4] |

| Kreativer Workflow | Prompting, image/video conditioning, looping, extension, interpolation, image generation. [1][3] | Storyboards, Styles, Characters, Stitching, Editor, Extensions, image-to-video mit Menschen unter strengeren Regeln. [5] |

| Oberfläche | Web-first, Research-Preview-Energie, Legacy-Zweig. [1] | App-first, sozialer und kreativer Workflow mit Feed-Logik und Mobile-Rollout. [4][5] |

| Nach dem 13. März 2026 in den USA | Entfernt. Nutzer können nicht mehr zurückwechseln. [1] | Standard-Erfahrung von Sora. [1] |

Die offizielle Erklärung ist kurz. OpenAI sagt, dass Sora 1 auf older models and infrastructure basierte und dass der Wechsel zu einer einzigen Sora-Erfahrung die Komplexität reduziert, während das Team Sora 2 auf Web und Mobile weiter verbessern kann. [1] Für eine Produktentscheidung ist diese Begründung in sich schlüssig und ausreichend.

Gleichzeitig ist klar, dass das Produkt der ursprünglichen Struktur längst entwachsen war. Ende 2025 und Anfang 2026 ging es bei Sora nicht mehr nur um isolierte Generationen. Es war eine App mit Feed-Verhalten, Characters, Styles, Stitching, längeren Clips, Mobile-Rollout und einer anderen Monetarisierungsoberfläche geworden. [4][5] Einen separaten Legacy-Zweig für Sora 1 weiterzuführen hätte bedeutet, ältere Bild- und Videopfade mitzuschleppen, während das Hauptteam längst woanders baute.

Es gibt auch eine Governance- und Vertrauensebene. Eine einzige aktive Oberfläche lässt sich leichter moderieren, erklären, watermarken und weiterentwickeln als zwei parallele Nutzererfahrungen mit unterschiedlichen Annahmen und Fähigkeiten. OpenAI formuliert diesen Teil im FAQ nicht direkt so, aber die Produktrichtung zeigt klar dorthin. Das ist eine Schlussfolgerung aus den Quellen und kein direktes Zitat. [1][4][10]

Die schlechteste Retrospektive wäre eine, die Sora entweder nur als Triumph oder nur als unverantwortliches Produkt darstellt. Die Wahrheit ist, dass beides zugleich stimmte, oft aus denselben Gründen.

Deepfakes wurden von abstrakter Angst zu Consumer-Realität

TIME berichtete, dass Reality Defender Soras Anti-Impersonation-Schutz innerhalb von 24 Stunden umgehen konnte, und der CEO sprach von einem plausible sense of security. [7] Das ist eine ernste Kritik, weil genau Soras Realismus ihre kulturelle Wucht ausmachte.

Public-interest-Gruppen sahen ein Problem im Launch-Tempo

AP berichtete, dass Public Citizen Sora 2 als consistent and dangerous pattern bezeichnete, Produkte zu schnell ohne ausreichende Guardrails auf den Markt zu bringen. [8] Ob man dieser Formulierung zustimmt oder nicht, sie spiegelt ein reales Problem in der öffentlichen Wahrnehmung von OpenAIs Release-Tempo wider.

OpenAI musste Sicherheit laufend verschärfen und zugleich neue Features ausrollen

Aus den eigenen Materialien zu Sora 2 wird deutlich, wie stark das Produkt eigentlich ein Safety-Stack-Problem ist: Likeness-Kontrollen, strengere Regeln für Minderjährige, sichtbare Wasserzeichen, Provenance-Metadaten, Content Moderation und unterschiedliche Einschränkungen bei realistischen Menschen. [4][10]

Je stärker das Produkt wurde, desto schwerer ließ sich Kreativität von Risiko trennen

Genau darin liegt die ungelöste Spannung in Soras Geschichte. Dieselben Upgrades, die das Tool kreativer und nützlicher machten, verschärften zugleich das Vertrauensproblem. Mehr Realismus, mehr Kontrolle und leichteres Remixing sind kreative Gewinne, aber auch Multiplikatoren für Missbrauch, wenn Governance versagt. [4][7][8][10]

Sora 1 hinterlässt etwas Wichtigeres als nur eine einzelne Produktoberfläche. Sie hat die Messlatte dafür verschoben, was Menschen von AI-Video erwarten. Vor Sora wirkten viele Outputs noch wie kurzlebige Experimente. Nach Sora verlagerte sich das Gespräch auf Realismus, Persistenz, Editing-Workflows, Audio, Social Reuse und Vertrauen im großen Maßstab. [3][4][5]

Darum ist die Abschaltung von Sora 1 keine kleine Notiz in der Produktpflege. Sie beendet die erste Phase von OpenAIs Videogeschichte. Das Kapitel des Research-Preview ist vorbei. Jetzt zählt das Kapitel der App und Plattform.

Wenn man die ganze Geschichte auf eine einfache menschliche Lesart herunterbrechen will, dann diese: Sora 1 hat bewiesen, dass sich das Feld verändert hat. Sora 2 ist die Version, die OpenAI öffentlich weiterpushen will. Und dass das Unternehmen die alte Schicht so schnell eingestellt hat, zeigt, wie schnell sich Produkt, Infrastruktur und Risikoprofil gleichzeitig verschoben haben.

Nein. Offiziell hat OpenAI `Sora 1` am 13. März 2026 in den USA abgeschaltet. `Sora 2` bleibt dort die Standard-Erfahrung von Sora. [1]

OpenAI sagt, dass Sora 1 auf älteren Modellen und älterer Infrastruktur basierte. Das Unternehmen wechselte zu einer einzigen Sora-2-Erfahrung, um Komplexität zu reduzieren und den neueren Stack auf Web und Mobile weiterzuentwickeln. [1]

In den USA verloren Nutzer den Zugriff auf die alte Sora-1-Web-Erfahrung, auf ältere Generierungen und soziale Aktivität nach der Abschaltung, sofern sie ihre Daten nicht rechtzeitig exportierten, und auch die Bildgenerierung innerhalb von Sora verschwand zusammen mit Sora 1. [1]

Die ursprüngliche Sora war wichtig, weil sie längeres und kohärenteres AI-Video auf einem Niveau plausibel machte, das der Markt zuvor nicht gesehen hatte. OpenAIs Paper von 2024 hob minutenlange Generierung, object permanence, Multi-Shot-Konsistenz, Looping, Extension und stärkeres Framing über verschiedene Seitenverhältnisse hervor. [3]

OpenAI beschreibt Sora 2 als physikalisch präziser, kontrollierbarer und fähig, synchronen Dialog und Soundeffekte zu erzeugen. Dazu kamen app-first Funktionen wie Storyboards, Characters, Stitching, Styles, Editing und Extensions. [4][5]

Weil genau der Realismus, der Sora beeindruckend machte, auch Sorgen um Impersonation, Consent, Deepfakes und Copyright verschärfte. Externe Berichte von TIME, AP und Kritiker:innen wie Public Citizen zeigen, dass diese Fragen selbst mit wachsendem Produktreifegrad zentral blieben. [7][8]

Dieser Artikel stützt sich auf OpenAI-Hilfeseiten und Produktseiten, das Research Paper von 2024, die Sora-2-Launch-Materialien von 2025 sowie externe Berichterstattung zu Sicherheit, Privatsphäre und öffentlicher Kritik rund um das Produkt.

• 3. OpenAI Research: Video generation models as world simulators

• 6. AP News: OpenAI releases AI video generator Sora but limits how it depicts people

• 7. TIME: OpenAI's Sora Underscores the Growing Threat of Deepfakes

• 8. AP News: Public Citizen demands OpenAI withdraw Sora over deepfake dangers

• 10. OpenAI Help Center: Generating content with characters

Verwandte Artikel

AI SEO / GEO im Jahr 2026: Ihre nächsten Kunden sind nicht Menschen — sondern Agents

Suche verschiebt sich von Klicks zu Antworten. Bots und AI-Agents crawlen, zitieren, empfehlen — und kaufen zunehmend. Erfahren Sie, was AI SEO / GEO bedeutet, warum klassisches SEO nicht mehr reicht und wie PAS7 Studio Marken im agentischen Web sichtbar macht.

Der leistungsstärkste Chip von Apple? M5 Pro und M5 Max brechen Rekorde

Eine Analyse zu Apple M5 Pro und M5 Max im März 2026. Wir zeigen, warum diese Chips als die stärksten professionellen Laptop-SoCs von Apple gelten können, wie sie sich gegen M4 Pro, M4 Max, M1 Pro, M1 Max schlagen und was der Vergleich mit aktuellen Intel- und AMD-Chips zeigt.

Automatisches Tagging und Suche für gespeicherte Links

Integration mit GDrive/S3/Notion für automatisches Tagging und schnelle Suche über Such-APIs

Bot-Entwicklung und Automatisierungs-Dienste

Professionelle Telegram-Bot-Entwicklung und Automatisierung von Geschäftsprozessen: Chatbots, KI-Assistenten, CRM-Integrationen und Prozessautomatisierung.

Professionelle Entwicklung für Ihr Geschäft

Wir erstellen moderne Web-Lösungen und Bots für Unternehmen. Erfahren Sie, wie wir Ihnen helfen können, Ihre Ziele zu erreichen.