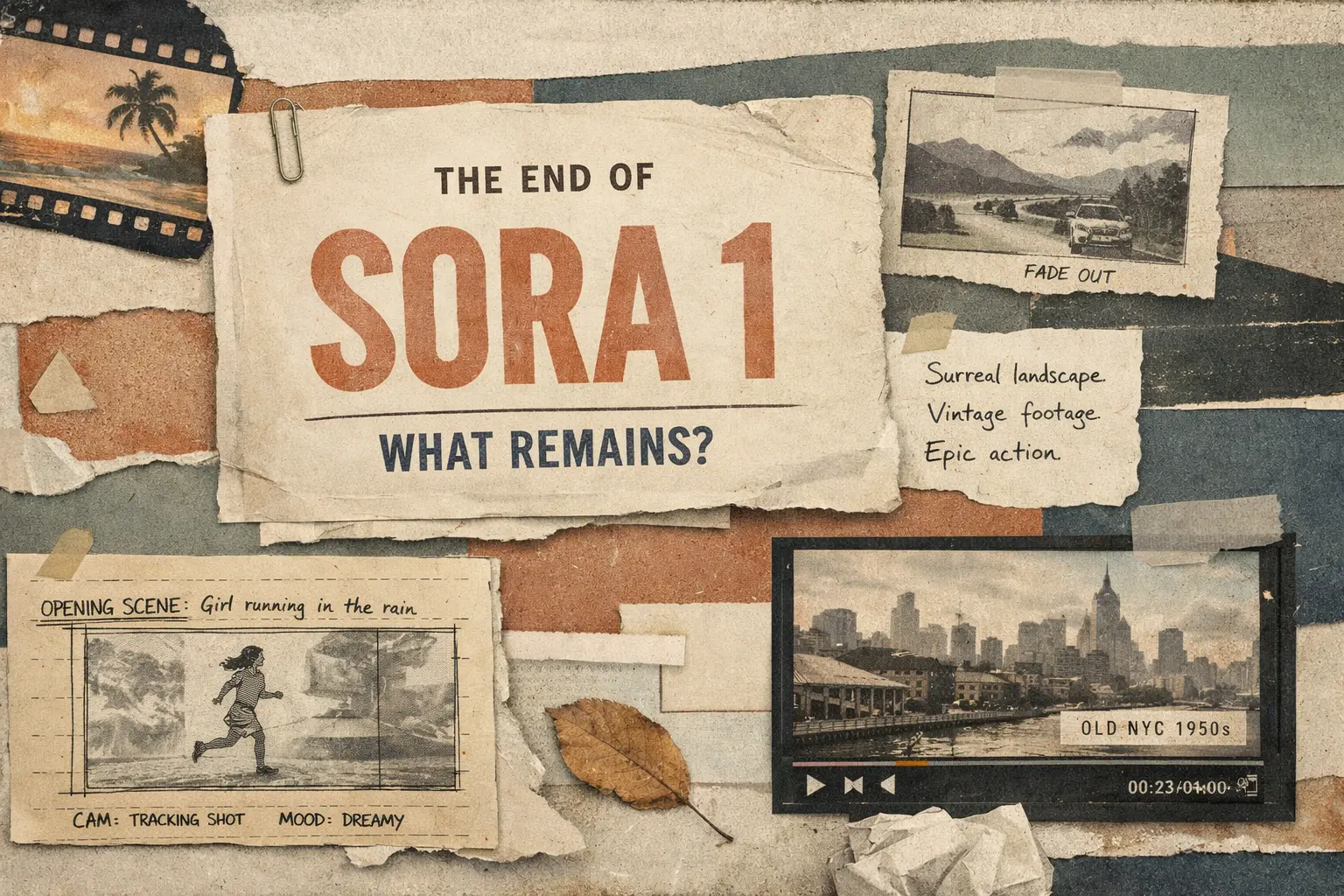

Sora 1 завершується. Що вона залишила після себе?

Що саме OpenAI закриває у 2026 році: що сталося із Sora 1, як Sora пройшла шлях від дослідницького прориву 2024 року до Sora 2, що вона встигла змінити в AI-відео, чому стару версію прибирають і чому дискусія навколо ризиків так і не зникла.

про головне

Якщо винести з цього блогу лише одну думку, нехай це буде така: кінець Sora 1 не означає кінець Sora. OpenAI прибрала старий шар, бо хотіла один новий продукт, один новий стек і одну зрозумілу історію для користувача.

Почати варто з головного уточнення. Якщо триматися офіційних формулювань, OpenAI не закрила Sora повністю. Компанія закрила Sora 1 у США 13 березня 2026 року і перевела всіх на Sora 2. [1]

У центрі підтримки це прописано доволі прямо. Там сказано, що Sora 1 більше недоступна у США, Sora за замовчуванням відкривається в Sora 2, а image generation всередині Sora після цього більше немає. [1] Саме цей момент добре показує, наскільки перший продукт був зав'язаний на старий стек.

Офіційне пояснення теж без зайвої драми: Sora 1 трималася на older models and infrastructure, а перехід до одного продукту зменшує складність і дає змогу далі розвивати Sora 2 і на вебі, і на мобільних платформах. [1] Це більше схоже на збір продукту в одну лінію, ніж на гучний похорон невдалого інструмента.

Sora рухалася дуже швидко. За трохи більш ніж два роки вона пройшла шлях від research preview, який змусив увесь ринок зупинитися і подивитися, до споживчого app, а потім до legacy-шару, який OpenAI вже була готова прибрати.

Sora з'являється як дослідницький шок

У research paper OpenAI показала Sora як модель, здатну генерувати до хвилини якісного відео. Але головне було навіть не в довжині. Було видно object permanence, довшу зв'язність сцени, рух камери, looping, video extension, interpolation і загалом значно вищу цілісність ролика, ніж ринок тоді звик бачити. [3]

Sora стає реальною продуктовою поверхнею

Коли Sora дійшла до ширшого доступу, OpenAI вже подавала її не просто як демо моделі. AP окремо писало і про реліз, і про ранні обмеження щодо зображення людей. Це був сигнал, що профіль ризику тут уже зовсім не такий, як у звичайного image tool. [6]

Sora 2 зміщує центр ваги

OpenAI описала Sora 2 як фізично точнішу, реалістичнішу, більш керовану модель із synchronized dialogue та sound effects. І запускалася вона вже через новий Sora app, а не просто як старий веб-експеримент. [4]

Продукт швидко обростає новими можливостями

Release notes показують, як продукт доростав буквально місяць за місяцем: storyboards, cameos, далі characters, stitching, styles, Android, довші відео, image-to-video з людьми під жорсткішими правилами та video extensions. [5]

Sora 1 стає legacy-гілкою

OpenAI закриває Sora 1 у США, переводить користувачів на Sora 2 за замовчуванням і прибирає генерацію зображень із самої Sora. Саме в цей момент перша, вебова Sora перестає бути головною частиною продуктової історії. [1]

Висновок

У Sora було не одне життя. Спочатку дослідницьке, потім продуктове. І тепер лишилося тільки друге.

Часто про Sora говорять просто як про «той AI-відео-сервіс, де ролики виглядали краще». Це занадто примітивно. Важливість Sora в тому, що вона за короткий час стиснула в собі кілька етапів розвитку всього ринку.

Вона зробила довге AI-відео правдоподібним

У статтях 2024 року справа була не лише в красивих роликах. OpenAI показувала, що велике відеонавчання може тягнути хвилинні сцени, різні aspect ratio, looping, extension і більш цілісні multi-shot outputs, ніж ринок тоді звик бачити. [3]

Вона витягнула розмову про world models у мейнстрим

Вона перетворила генерацію відео на продукт, а не просто на демо

Найпростіше зрозуміти sunset через пряме порівняння Sora 1 і Sora 2. Назва лишилася та сама, але продуктова логіка вже інша.

| Comparison point | Sora 1 / перша вебова епоха | Sora 2 / поточний напрям |

|---|---|---|

| Базова ідентичність | Legacy-вебдосвід, зав'язаний на старішу video та image generation інфраструктуру. [1] | Єдиний стандартний досвід Sora, побудований навколо новіших моделей і ширшого app-plus-web продукту. [1][4] |

| Головна обіцянка | Доказ того, що довше і якісніше AI-відео взагалі можливе. [3] | Фізично точніша і більш керована модель із synchronized dialogue та sound effects. [4] |

| Творчий workflow | Prompting, image/video conditioning, looping, extension, interpolation, image generation. [1][3] | Storyboards, styles, characters, stitching, editor, extensions, image-to-video з людьми під жорсткішими правилами. [5] |

| Поверхня продукту | Web-first, з енергією research preview і статусом legacy-гілки. [1] | App-first продукт із feed-логікою, social reuse і виходом на мобільні платформи. [4][5] |

| Після 13 березня 2026 у США | Прибрана. Повернутися до неї вже не можна. [1] | Стандартний досвід Sora. [1] |

Офіційне пояснення коротке. OpenAI каже, що Sora 1 залежала від older models and infrastructure, а перехід до одного Sora experience зменшує складність і дає команді змогу спокійно розвивати Sora 2 на вебі та мобільних платформах. [1] І для продуктового рішення цього пояснення вже достатньо.

Але видно і ще одну річ: сам продукт на той момент уже переріс свою початкову форму. Наприкінці 2025 і на початку 2026 Sora була вже не просто місцем для окремих генерацій. Це був app із feed-поведінкою, characters, styles, stitching, довшими кліпами, мобільним rollout і зовсім іншою монетизаційною логікою. [4][5] Тримати поруч окрему legacy-гілку Sora 1 означало б підтримувати старі image-and-video pathways у той момент, коли основна команда вже будувала інший продукт.

Є й окремий trust та governance кут. Один активний продукт простіше модерується, маркується, простіше ставити водяні знаки і оновлювати, ніж дві паралельні поверхні з різними припущеннями та можливостями. У FAQ OpenAI прямо цього не каже, але сам напрям розвитку продукту явно на це вказує. [1][4][10]

Найгірший спосіб написати ретроспективу про Sora це зробити вигляд, ніби вона була або тільки великим успіхом, або тільки безвідповідальним запуском. Насправді обидві лінії йшли паралельно.

Deepfakes перестали бути абстрактним страхом

TIME писав, що Reality Defender змогла обійти антиімперсонаційні захисти Sora вже в першу добу, а її CEO описав це як plausible sense of security. [7] Це серйозна претензія, бо саме реалістичність і зробила Sora культурно такою помітною.

Громадські організації побачили проблему в темпі релізів

AP писало, що Public Citizen назвала реліз Sora 2 consistent and dangerous pattern поспіху з виведенням продуктів на ринок без достатніх guardrails. [8] З таким формулюванням можна сперечатися, але воно добре фіксує реальну суспільну недовіру до темпу запусків OpenAI.

OpenAI доводилося одночасно посилювати безпеку і відкривати нові функції

Sora 1 залишає після себе дещо більше, ніж один продуктовий інтерфейс. Вона змінила базову планку того, чого люди взагалі чекають від AI-відео. До Sora багато роликів усе ще виглядали як короткі експерименти. Після Sora розмова вже пішла про реалізм, цілісність сцени, монтажні workflow, аудіо, social reuse і trust на великому масштабі. [3][4][5]

Саме тому завершення Sora 1 це не дрібна продуктова примітка. Це закриття першого етапу відеоісторії OpenAI. Етап research preview закінчився. Реальним став етап app і платформи.

Якщо коротко, то історія така: Sora 1 показала, що ринок уже змінився. Sora 2 це версія, яку OpenAI вважає придатною для подальшого публічного розвитку. А той факт, що старий шар прибрали так швидко, добре показує, наскільки стрімко одночасно рухалися і сам продукт, і інфраструктура, і весь профіль ризику навколо нього.

Ні. Офіційно OpenAI закрила `Sora 1` у США 13 березня 2026 року. `Sora 2` після цього лишається стандартним і єдиним актуальним досвідом Sora на цьому ринку. [1]

За офіційною версією, Sora 1 працювала на older models and infrastructure. Компанія перевела продукт на єдиний досвід Sora 2, щоб зменшити складність і продовжувати розвиток новішого стеку на вебі та мобільних платформах. [1]

У США зник доступ до legacy-версії Sora 1, до старих generations і social activity після завершення терміну, якщо користувач не експортував дані вчасно. Разом із цим із самої Sora прибрали і image generation. [1]

Перша Sora стала важливою тому, що показала більш довге і значно цілісніше AI-відео на рівні, якого ринок раніше майже не бачив. У paper 2024 року OpenAI окремо виділяла хвилинні сцени, object permanence, multi-shot consistency, looping, extension і кращу стабільність на різних aspect ratios. [3]

OpenAI подає Sora 2 як фізично точнішу, більш керовану модель із synchronized dialogue та sound effects. Поверх цього продукт отримав app-first можливості на кшталт storyboards, characters, stitching, styles, editor та extensions. [4][5]

Тому що та сама реалістичність, яка робила Sora сильною, одночасно підсилювала страхи навколо impersonation, consent, deepfakes і copyright. Це добре видно і в текстах TIME, і в матеріалах AP, і в критиці з боку Public Citizen. [7][8]

Даний блог спирається на офіційні сторінки OpenAI, початковий research paper 2024 року, матеріали запуску Sora 2 у 2025 році та зовнішні публікації про безпеку, приватність і суспільну критику продукту.

• 3. OpenAI Research: Video generation models as world simulators

• 6. AP News: OpenAI releases AI video generator Sora but limits how it depicts people

• 7. TIME: OpenAI's Sora Underscores the Growing Threat of Deepfakes

• 8. AP News: Public Citizen demands OpenAI withdraw Sora over deepfake dangers

• 10. OpenAI Help Center: Generating content with characters

Пов'язані статті

AI SEO / GEO у 2026: ваші наступні клієнти — не люди, а агенти

Пошук зміщується від кліків до відповідей. Боти та AI-агенти сканують, цитують, рекомендують і дедалі частіше купують. Дізнайтесь, що таке AI SEO / GEO, чому класичного SEO вже недостатньо, і як PAS7 Studio допомагає брендам перемагати у «агентному» вебі.

Найпотужніший чіп від Apple? M5 Pro і M5 Max б'ють рекорди

Аналітичний розбір Apple M5 Pro і M5 Max станом на березень 2026 року. Пояснюємо, чому ці чіпи можна вважати найпотужнішими професійними ноутбучними SoC від Apple, як вони виглядають на тлі M4 Pro, M4 Max, M1 Pro, M1 Max і що показують у порівнянні з актуальними Intel та AMD.

Автоматичне тегування та пошук збережених посилань

Інтеграція з GDrive/S3/Notion для автоматичного тегування та швидкого пошуку через пошукові API

Розробка Telegram-ботів та автоматизація

Професійна розробка Telegram-ботів та автоматизація бізнес-процесів: чат-боти, AI-асистенти, інтеграції з CRM та автоматизація процесів.

Професійна розробка для вашого бізнесу

Створюємо сучасні веб-рішення та боти для бізнесу. Дізнайтеся, як ми можемо допомогти вам досягти цілей.