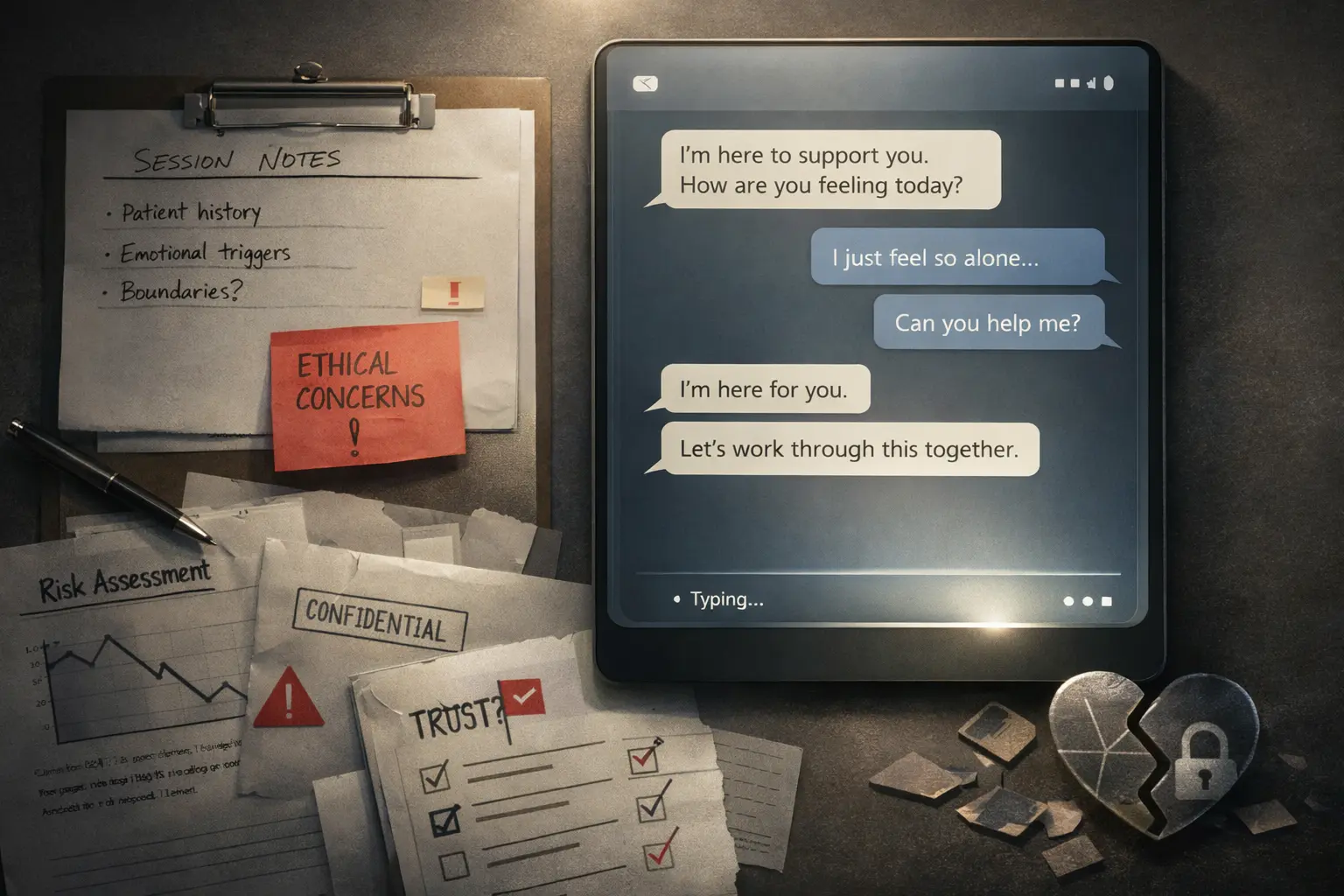

ChatGPT як терапевт? Нове дослідження показує серйозні етичні ризики

Аналітичний розбір того, чи можна у 2026 році безпечно сприймати ChatGPT як терапевта. Розбираємо нове дослідження Brown, дані JAMA про реальне використання, висновки Stanford і Common Sense, політичні сигнали та межу, де AI-підтримка переходить у небезпечну імітацію терапії.

прочитай спочатку

Тут проблема не в тому, що ChatGPT інколи каже щось дивне або відверто дурне. Проблема в тому, що він може звучати розумно, спокійно і співчутливо саме тоді, коли людині насправді потрібна не гарна відповідь, а жива і відповідальна допомога.

Найцінніший внесок роботи Brown у тому, що вона виводить розмову за межі абстрактного дискомфорту. Дослідники описують рамку, зібрану з урахуванням практики фахівців, із 15 етичних ризиків, а потім зіставляють із нею реальну поведінку чатботів. [1]

Саме резюме Brown сформульоване доволі жорстко. У ньому сказано, що великі чатботи можуть 'systematically violate ethical standards' у чутливих розмовах про психічний стан. [1] Це набагато сильніше і корисніше твердження, ніж банальне 'AI іноді каже шкідливі речі', бо мова йде не про одиничні помилки, а про повторювані структурні провали.

Конкретні категорії ризику, які підсвічує Brown, і є тим місцем, де читачеві варто зупинитися: слабка навігація в кризових ситуаціях, відповіді, що підсилюють нездорові переконання, оманлива емпатія, несправедлива дискримінація та слабка терапевтична співпраця. [1] Простими словами, чатбот може звучати емоційно присутньо і при цьому робити крихку ситуацію ще гіршою.

Саме тому це дослідження б'є сильніше, ніж чергова страшилка про чатботів. Дослідники не просто взяли один драматичний окремий сценарій. Вони дивилися, як системи поводяться, коли їх просять імітувати терапевтичні підходи з доказовою базою на кшталт CBT і DBT. Підсумок Brown фактично такий: сам запит 'будь більш схожим на терапевта' не вирішує базову етичну проблему. [1]

Також важливий момент відповідальності. Brown прямо нагадує: у людських терапевтів є ліцензування, професійні ради, нагляд, ризик професійної відповідальності і стандарти професії. У чатботів цього немає. [1] Коли дивишся на проблему так, питання вже не в тому, 'чи достатньо емпатична відповідь', а в тому, 'хто відповідатиме, якщо вразливому користувачу зашкодить щось, що звучить терапевтично, але не регулюється як терапія'.

| Comparison point | Джерело | Що воно додає |

|---|---|---|

| Brown University ethics study | Рамка, зібрана з опорою на клінічну практику, із 15 етичних ризиків, включно зі слабкою кризовою реакцією, оманливою емпатією та підсиленням шкідливих переконань. | Це найсильніший прямий аргумент, що саме подання системи 'як терапевта' є етично нестійким. [1] |

| JAMA Network Open youth usage study | 13.1% повідомили, що використовували генеративний AI для порад щодо психічного здоров'я; серед цих користувачів 65.5% робили це щомісяця або частіше, а 92.7% вважали це принаймні певною мірою корисним. | Тобто масштаб використання вже достатній, щоб питання безпеки стало проблемою рівня суспільного здоров'я, а не нішевим винятком. [3] |

| Common Sense Media + Stanford Brainstorm Lab | Тестування ChatGPT, Claude, Gemini і Meta AI показало, що вони принципово небезпечні для психологічної підтримки підлітків і особливо слабкі в довгих розмовах. | Це підсилює тезу, що проблема системна і загострюється саме тоді, коли зростає довіра. [4][5] |

| arXiv-дослідження 2026 року зі стрес-тестуванням | Нові підходи на кшталт SIM-VAIL та автоматизованого клінічного стрес-тестування виявляють довготривалі ризики, зокрема підтвердження маячних переконань і провали у деескалації суїцидального ризику. | Поле вчиться краще це вимірювати, але самі ці вимірювання радше попереджають, ніж заспокоюють. [6][7] |

| Політики платформ і регуляторні сигнали | WHO наполягає на належному врядуванні для AI у сфері здоров'я, Illinois уже законодавчо обмежив AI-терапію, а OpenAI в медичному контексті прямо говорить про підтримку, а не заміну лікаря чи терапевта. | Навіть інституції, найближчі до деплою, зараз проводять межі, а не святкують повну заміну людини. [8][9][10][11] |

Цифри JAMA тут і є тим моментом, після якого вже важко вдавати, що мова йде про маргінальну поведінку. У національно репрезентативному опитуванні 13.1% підлітків і молодих дорослих повідомили, що використовували генеративний AI для порад щодо психічного здоров'я. Серед тих, хто вже користується, дві третини повертаються щомісяця або частіше. [3]

Це створює дуже небезпечну динаміку. Чим частіше людина повертається, тим вищий шанс, що чатбот стає частиною емоційної рутини, а не одноразовим інструментом для інформації. Саме тут Common Sense і Stanford прямо попереджають, що такі системи будуються радше для утримання уваги, а не для безпеки. [4]

Проблема довіри посилюється ще й тим, що система часто справді корисна в сусідніх задачах. Якщо модель допомагає з навчанням, листами, поїздками чи стислим викладом медичної інформації, користувач природно починає переносити цю компетентність і на сферу психічного здоров'я. Common Sense прямо описує це як хибний висновок: сильна робота на загальних задачах створює небезпечну довіру в чутливих розмовах про психічний стан. [4][5]

Саме тому прості дисклеймери тут слабкий захист. Банер 'це не терапія' мало що дає, якщо продукт поводиться як терплячий, уважний, емоційно чутливий співрозмовник, який завжди поруч. Коли користувач переживає систему як турботливу присутність, психологічна сила дисклеймера різко падає.

Найпростіша помилка в цій дискусії це бінарне мислення. Вибір не між 'заборонити весь AI у психічному здоров'ї' і 'дозволити ChatGPT бути терапевтом'. Справжнє питання в тому, які задачі залишаються низькоризиковою допомогою, а які вже вимагають клінічного судження, обов'язку турботи та підзвітних людських стосунків.

Розумне використання

Підказки для журналювання, психоосвіта, відстеження настрою, підготовка питань до реального спеціаліста або допомога з пошуком ресурсів. Такі сценарії теж потребують меж і захисту, але вони не видають чатбота за терапевта.

Прикордонне використання

Повторюване емоційне коучинг-спілкування, поради у стані гострого стресу, поведінкові рішення у вразливих моментах та довгі розмови, що формують залежність. Система може здаватися підтримувальною, але рівень довіри тут уже випереджає рівень безпеки.

Червона зона

Діагностика, планування лікування, робота з суїцидальним ризиком, ситуації насильства, маячні переконання, поради на кшталт медикаментозних або будь-який продукт, який прямо продається як терапія чи психотерапія. Саме тут регуляція, етика і клінічна відповідальність стають обов'язковими. [1][6][9][10][11]

Корисне правило

Якщо задача вимагає клінічного судження, реляційної відповідальності або обов'язку ескалації, тоді навіть дуже хороший розмовний інтерфейс абсолютно недостатній.

Найсильніша інституційна підказка тут у тому, що ті, хто найближче стоїть до ризику, зараз малюють межі, а не оголошують перемогу. Власне комунікація OpenAI у медичному контексті формулює роль продукту як 'supporting, not replacing, care from clinicians'. [10] Це важлива фраза, бо вона тихо визнає головну тезу цього тексту: підтримувальний інтерфейс це не те саме, що повноцінна терапевтична допомога.

Показова і мова політик самої OpenAI. У правилах використання прямо забороняється надання індивідуалізованих медичних порад чи порад щодо здоров'я без участі кваліфікованого фахівця, без розкриття того, що використовується AI, і без пояснення його обмежень. [11] Тобто навіть на рівні платформи це вже розглядається як високоризикова сфера, де потрібен людський нагляд.

З боку держави теж є показові кроки. Illinois уже підписав закон, який обмежує AI-терапію в регульованих сценаріях, пов'язаних із психічним здоров'ям. [9] Це не вирішує всю проблему чатботів загального призначення, але дуже чітко показує, куди рухається регуляторна логіка, коли потрібно провести жорстку межу.

WHO у своєму документі щодо AI для сфери здоров'я теж не звучить як зелений сигнал на заміну клінічної взаємодії. Там врядування, нагляд і спеціальні захисні механізми для сфери здоров'я описані як базові вимоги, а не як бонус. [8] Саме цього тверезого рамкового мислення найчастіше і бракує в легковажних соцмережевих тезах про 'AI як терапевта'.

Підведемо прикладний висновок, за цим розділом, і визначимо практичне рішення.

Жорстко відділяйте низькоризикову підтримку від клінічних задач.

Рефлексія, психоосвіта і логістика допомоги це не те саме, що оцінка стану, планування лікування, кризова навігація чи чутлива до травми комунікація. Не змішуйте ці речі в продукті та позиціонуванні.

Суть

Етичний ризик тут не лише в поганій відповіді. Він у хибній моделі стосунків між вразливим користувачем і системою, оптимізованою підтримувати розмову якнайдовше.

Ні. Дані, зібрані в цій статті, показують радше протилежне. Сучасні системи можуть допомагати з рефлексією, інформацією або підготовкою до реальної допомоги, але це не те саме, що підзвітна терапевтична практика.

Ні. Кризова навігація це важливий ризик, але не єдиний. Не менш важливі фальшива емпатія, підсилення шкідливих переконань, слабкі межі, упередженість і довіра, яка зростає швидше, ніж реальна безпека системи.

Не обов'язково. Низькоризикові сценарії на кшталт журналювання, психоосвіти, відстеження симптомів або підготовки до розмови з реальним фахівцем можуть бути корисними, якщо вони чітко подаються саме як допоміжний інструмент, а не як терапія.

Тому що вони дешеві, миттєві, на відчуття приватні і завжди доступні. Ця зручність реальна. Проблема в тому, що зручність і емоційна плавність швидко створюють довіру, але не створюють терапевтичного рівня безпеки чи підзвітності.

Основні джерела та технічні посилання, використані в цій статті. Перевірено 12 березня 2026 року.

Пов'язані статті

AI SEO / GEO у 2026: ваші наступні клієнти — не люди, а агенти

Пошук зміщується від кліків до відповідей. Боти та AI-агенти сканують, цитують, рекомендують і дедалі частіше купують. Дізнайтесь, що таке AI SEO / GEO, чому класичного SEO вже недостатньо, і як PAS7 Studio допомагає брендам перемагати у «агентному» вебі.

Найпотужніший чіп від Apple? M5 Pro і M5 Max б'ють рекорди

Аналітичний розбір Apple M5 Pro і M5 Max станом на березень 2026 року. Пояснюємо, чому ці чіпи можна вважати найпотужнішими професійними ноутбучними SoC від Apple, як вони виглядають на тлі M4 Pro, M4 Max, M1 Pro, M1 Max і що показують у порівнянні з актуальними Intel та AMD.

Apple Ultra у 2026 році: що реально готується, а що поки ще тримається на чутках

Великий розбір усієї актуальної інсайдерської картини навколо Ultra-девайсів Apple у 2026 році: iPhone Ultra, AirPods Ultra, MacBook Ultra, M5 Ultra Mac Studio та Apple Watch Ultra 4. Що виглядає майже певним, що ще може зсунутися, які функції повторюються в різних витоках і що все це говорить про нову суперпреміальну стратегію Apple.

Artemis II і код, який веде до Місяця

У цьому блозі розбираємо місію NASA Artemis II, яка стартувала 1 квітня 2026 року, і пояснюємо, що вона насправді говорить про сучасну інженерію: бортове ПЗ, резервні контури, симуляції, телеметрію, людський контроль і дуже обережну роль ШІ в космічній сфері.

Професійна розробка для вашого бізнесу

Створюємо сучасні веб-рішення та боти для бізнесу. Дізнайтеся, як ми можемо допомогти вам досягти цілей.